Semántica distribucional

As referencias deste artigo non teñen un formato correcto. Podes colaborar editándoas como se indica nesta páxina. Pode axudar a mellorar este artigo e outros en condicións semellantes. |

Atención: Este artigo ou apartado precisa dun traballo de revisión.

Cando os problemas se resolvan, retire esta mensaxe, pero non quite esta mensaxe ata que estea todo solucionado. De ser posible, sería mellor substituír este marcador por outro máis específico. (Desde agosto de 2024) |

A semántica distribucional (SD) é unha área de investigación que busca desenvolver teorías e métodos que permitan analizar as semellanzas semánticas entre elementos lingüísticos en función das súas propiedades distribucionais[1]. Estes métodos a miúdo inclúen o uso de grandes cantidades de texto, que se procesan e abstraen para dar lugar a un modelo distribucional que representa significados dos elementos mediante vectores[2]. A fundamentación teórica da SD atópase na hipótese distribucional, que sostén que os elementos lingüísticos con distribucións similares teñen significados similares[3]. Estes elementos poden ser morfemas, palabras, frases, oracións ou discursos, dependendo da cuestión que se desexe analizar[2].

O principal obxecto do estudo da semántica distribucional é o léxico, pois busca fórmulas para representar os significados, así como métodos computacionais que permitan aplicar esas representacións en diversas tarefas centradas no tratamento das linguas naturais[3]. Polo tanto, é unha área estreitamente relacionada co procesamento da linguaxe natural, a intelixencia artificial e a lingüística computacional.

Hipótese distribucional

[editar | editar a fonte]A hipótese distribucional provén da teoría semántica do uso da lingua, pola que se entende que as palabras que se empregan en contextos similares tenden a presentar significados similares[4][3]. Esta idea segue a liña de lingüistas como Firth, que popularizou a idea de que as palabras se ven caracterizadas polas outras palabras coas que se combinan[5], así como Harris, que establece que unha distribución diferente implica significados diferentes[6]. Así, canto máis semellantes sexan dúas palabras semanticamente, estas presentarán unha distribución máis próxima, polo que é de esperar que aparezan tamén en contextos lingüísticos similares.

Esta hipótese ten a súa orixe na lingüística e supón a base teórica da semántica estatística. Con todo, nos últimos anos está gañando especial atención no eido da ciencia cognitiva, en especial no tocante ao contexto de uso das palabras[7][8], así como no ámbito da lingüística computacional, como concepto imprescindible dentro do ámbito do procesamento da linguaxe natural.

Nos últimos anos, a hipótese distribucional serviu de fundamento teórico para a teoría de xeneralización por medio de semellanza relacionada coa aprendizaxe de linguas, que sostén a idea que as e os cativos son capaces de utilizar palabras que apenas viron antes mediante unha estratexia de xeneralización do seu uso a partir da distribución de palabras similares.[9][10]

Deste xeito, a validez ou non da hipótese distribucional pode ter repercusións significativas no problema da escaseza de datos da modelaxe computacional[11]e na cuestión de como os nenos e nenas son capaces de aprender unha lingua tan rápido, incluso pese a relativa pobreza dos datos que reciben (o que tamén se coñece como a pobreza de estímulos).

Modelaxe de distribución semántica en espazos vectoriais

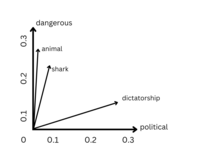

[editar | editar a fonte]A semántica distribucional favorece o uso da álxebra lineal como ferramenta computacional e framework representacional. O procedemento estándar implica recoller información distribucional en vectores de alta dimensióne definir as semellanzas distributionais/semánticas en termos de semellanzas vectoriais.[12] Dependendo do tipo de información que se obteña dos vectores, pódense distinguir diferentes tipos de semellanzas: as semellanzas tópicas, que se obteñen poboando os vectores de información sobre en que rexións do textos aparecen os elementos lingüísticos en cuestión; as semellanzas paradigmáticas, que se extraen poboando os vectores con información sobre con que outros elementos cos que aparecen os elementos lingüísticos en cuestión. A partir deste último tipo de vectores, é posible tamén extraer semellanzas sintagmáticas mediante o estudo dos compoñentes dos vectores individuais.

A correlación entre as semellanzas distribucionais e semánticas pódese tratar de diversas maneiras. Actualmente, existe unha gran variedade de modelos computacionais que permiten levar a cabo tarefas relacionadas coa semántica distribucional, tales como a análise semántica latente (LSA, das súas siglas en inglés), o hiperespacio análogo á lingua (HAL, das súas siglas en inglés), os modelos baseados na sintaxe ou nas dependencias, a indexación aleatoria e diferentes variantes do modelo temático, entre outros[13][14][15][16].

En xeral, os procedementos máis sinxelos de construción de vectores de semántica distribucional inclúen[3]:

- A extracción dos corpus e contabilización das ocorrencias entre elementos lingüísticos e os seus contextos;

- A representación das distribucións semánticas nunha matriz, colocando os elementos lingüísticos nas filas, os contextos nas columnas e establecendo a frecuencia das ocorrencias;

- A ponderación das frecuencias en bruto en función da importancia dos contextos;

- A medición da semellanza semántica entre elementos lingüísticos en función da similitude entre os vectores das filas da matriz.

Con todo, cabe destacar que os modelos de distribución semántica poden diferir en distintos parámetros, entre os cales destacan:

- O tipo de contexto (rexións textuais vs. elementos lingüísticos)

- A magnitude do contexto (tamaño, extensión etc.)

- A ponderación das frecuencias (por exemplo, a entropía etc.)[17]

- A redución das dimensións (por exemplo, a indexación aleatoria, a descomposición en valores singulares etc.)

- A medida de semellanza (por exemplo, a semellanza de coseno, a distancia de Minkowski etc.)

Aplicacións

[editar | editar a fonte]Os modelos de semántica distribucional aplicáronse con éxito nas seguintes tarefas:

- Busca da semellanza semántica entre palabras e expresións multipalabra;

- Agrupación palabras chave (word clustering) en base a semellanzas semánticas;

- Creación automática de tesauros e dicionarios bilingües;

- Desambiguación dos diferentes sentidos das palabras;

- Expansión de peticións de busca con sinónimos e asociacións;

- Definición do tema dun documento;

- Agrupación de documentos (document clustering) para a recuperación de información;

- Minaría de datos e recoñecemento de entidades nomeadas;

- Creación de mapas semánticos de diferentes dominios;

- Parafraseado;

- Análise de sentimentos;

- Modelaxe de preferencias na selección de palabras.

Retos e dificultades

[editar | editar a fonte]Dado que as linguas non se compoñen exclusivamente de elementos lingüísticos con significados inequívocos e estables, a semántica distribucional enfróntase a diversos fenómenos que complican a modelaxe e a análise das semellanzas. Entre eles, destaca a polisemia ou ambigüidade semántica, pola cal as palabras adoptan diferentes significados dependendo do contexto en que aparezan. Para salvar esta dificultade, véñense empregando dúas estratexias principais[2]:

- A representación de todos os sentidos posibles dun elemento lingüístico nun mesmo vector. Neste caso, cómpre empregar técnicas que permitan desambiguar os significados, que a miúdo se basean no concepto de composicionalidade. A idea é que, se se atende ao contexto concreto e aos elementos cos que interactúa a palabra ou expresión en cuestión, é posible establecer cal dos sentidos se está empregando nunha ocorrencia concreta. Por exemplo, se carreira aparece acompañada de profesional ou empresa, podería tratarse dunha referencia á actividade profesional dunha persoa. Con todo, se o contexto próximo contén elementos como coches ou kilómetros, é probable que se trate dunha competición deportiva.

- A representación de cada un dos sentidos dun elemento lingüístico en cadanseu vector. Neste caso, vólvese posible distinguir entre os diversos sentidos que pode adoptar unha palabra mediante a comparación directa dos vectores que a representan en cada contexto. Así, se estes vectores son similares, é probable que se trate do mesmo significado; pola contra, se existe unha distancia considerable entre ambos, cabería considerar se trata de dous sentidos distintos.

Notas

[editar | editar a fonte]- ↑ Lenci, Alessandro; Sahlgren, Magnus (2023). Distributional Semantics. Studies in Natural Language Processing. Cambridge: Cambridge University Press. ISBN 978-1-107-00429-0.

- ↑ 2,0 2,1 2,2 Boleda, Gemma (2020-01-14). "Distributional Semantics and Linguistic Theory". Annual Review of Linguistics (en inglés) 6 (1): 213–234. ISSN 2333-9683. doi:10.1146/annurev-linguistics-011619-030303.

- ↑ 3,0 3,1 3,2 3,3 Lenci, Alessandro (2018-01-14). "Distributional Models of Word Meaning". Annual Review of Linguistics (en inglés) 4 (1): 151–171. ISSN 2333-9683. doi:10.1146/annurev-linguistics-030514-125254.

- ↑ Harris 1954

- ↑ Pandit, P. B. (1970-09). "F. R. Palmer (ed.), Selected Papers of J. R. Firth 1952–59. London: Longmans, 1968. Pp. X + 209.". Journal of Linguistics 6 (2): 280–284. ISSN 0022-2267. doi:10.1017/s0022226700002693.

- ↑ Harris, Zellig S. (1954-08). "Distributional Structure". <i>WORD</i> 10 (2-3): 146–162. ISSN 0043-7956. doi:10.1080/00437956.1954.11659520.

- ↑ Sahlgren 2008

- ↑ McDonald & Ramscar 2001

- ↑ Gleitman 2002

- ↑ Yarlett 2008

- ↑ Murakami, Akira; Thompson, Paul; Hunston, Susan; Vajn, Dominik (2017-08). "‘What is this corpus about?’: using topic modelling to explore a specialised corpus". Corpora 12 (2): 243–277. ISSN 1749-5032. doi:10.3366/cor.2017.0118.

- ↑ Rieger 1991

- ↑ Deerwester et al. 1990

- ↑ Landauer, Thomas K.; Dumais, Susan T. (1997-04). "A solution to Plato's problem: The latent semantic analysis theory of acquisition, induction, and representation of knowledge.". Psychological Review (en inglés) 104 (2): 211–240. ISSN 1939-1471. doi:10.1037/0033-295X.104.2.211.

- ↑ Padó & Lapata 2007

- ↑ Blei, David M.; Ng, Andrew Y.; Jordan, Michael I. (2003). "Latent Dirichlet Allocation". Journal of Machine Learning Research 3 (Jan): 993–1022. ISSN 1533-7928.

- ↑ Church, Kenneth Ward; Hanks, Patrick (1989-06-26). "Word association norms, mutual information, and lexicography". Proceedings of the 27th annual meeting on Association for Computational Linguistics. ACL '89 (USA: Association for Computational Linguistics): 76–83. doi:10.3115/981623.981633.